AIで早期胃がんの範囲診断が可能に、内視鏡専門医に迫る診断精度達成 理研と国がん

理化学研究所(理研)と国立がん研究センター東病院の共同研究グループが、内視鏡専門医の診断精度に迫る早期胃がんの自動範囲診断AI(人工知能)を確立したと発表した。今後増加が予想される消化器内視鏡検診で医師の診断を補助し、施設間の診断格差などを減らせることが期待できるとしている。

少量の学習データで開発したAIが、専門医の診断制度に迫る精度に

研究成果を発表したのは、理化学研究所(理研)光量子工学研究センター 画像情報処理研究チームの竹本 智子 研究員、横田 秀夫 チームリーダー(情報統合本部 先端データサイエンスプロジェクト 副プロジェクトリーダー)、国立がん研究センター東病院 消化管内視鏡科の矢野 友規 科長、堀 圭介 医員(研究当時)らの共同研究グループ。

胃がんは最も死亡率が高いがんの一つであるが、早期の胃がんは隆起や陥凹(かんおう)などの形態的特徴が乏しく、胃炎などの炎症による変化との判別が難しいとされる。内視鏡検査での見逃しや検査装置、医師の技量の違いによる病変発見率の差が問題となっており、診断能の均てん化や増え続ける検査ニーズに対する医師の負担軽減のため、コンピュータを活用した診断支援技術が求められている。ただ、他の部位と比べ、学習用データとなる早期の胃がん発見例自体が少ないという問題が存在している。研究グループは先行研究において、少数のデータで病変特徴を効率的に学習できるAIを提案していたが、今回さらに進展させ、早期胃がんの範囲診断に向け、画像の1画素単位で病変の存在確率を予測できるAIを構築した。

このAIでは、先行研究での小規模なデータを効率的に学習できる機能を維持したうえで、消化器内視鏡の専門医が病変領域を正確にアノテーションした「がん画像」150枚、がんが含まれない「正常画像」150枚の計300枚を基にした学習を実現。これらの画像は、国立がん研究センター東病院で約1年間に収集された連続68症例から無作為に抽出された。データ拡張※1などによって約113万枚に増やした上で、早期胃がんの表面性状や色調などの細かな画像特徴をディープラーニングの一つである畳み込みニューラルネットワーク(CNN)※2で学習できるようにしている。

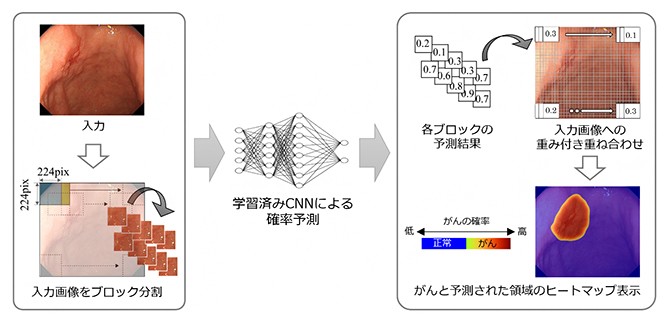

学習済みのCNNは、新たな入力画像に対して病変の存在確率を1画素単位で予測する。今回の研究では、予測したい画像を複数に分割してからCNNに入力し、複数回の予測結果を重ね合わせ予測の高精度化を図った。具体的には、範囲診断したい内視鏡画像を約1,600個のブロックに分割し、ブロックごとでの病変の存在確率を予測(図1)。予測結果を重み付け関数※3に従って重ね合わせることよって、各画素の予測は最大で約1,600回となり、予測精度が大幅に向上した。ブロック分割数と予測精度は比例する一方で、分割数と予測時間は反比例することから、将来の検診や日常診療などにおいては、予測性能とリアルタイム性のどちらを重視するかなど、目的によってブロック数を決定した上で、予測することが可能となった。

図1 早期胃がんの領域予測のフロー 学習済みの畳み込みニューラルネットワーク(CNN)を用いて、入力画像(内視鏡検査画像)に存在する早期胃がんの領域予測を実現するフローを示す。入力画像を可変数のブロックに分割し、CNNによってブロックごとの病変の存在確率を予測する。存在確率を重み付け関数に従って元の入力画像に当てはめることで、1画素ごとの存在確率が求められる。ヒートマップは、存在確率が50%以上の画素を病変領域としてレインボーカラーで表示したもの。

構築したAIを、学習用データとは別の約1年間に収集された連続137症例(がん画像462枚、正常画像396枚)を使って評価したところ、がん画像387枚(83.8%)、正常画像307枚(77.5%)で早期胃がんの有無を正しく判定したことが確認できた。陽性的中率※4は81.3%、陰性的中率※4は80.4%だった。症例ベースでは、130例(94.9%)で病変の有無を正しく判定した。また、専門医が内視鏡検査後の病理診断を参照して作成した正確な範囲診断と、AIによる予測領域とを比較したところ、IoU※5と呼ばれる正解領域と予測領域の一致度について、その評価指標の一種であるmIoU※5で66.5%を獲得した。

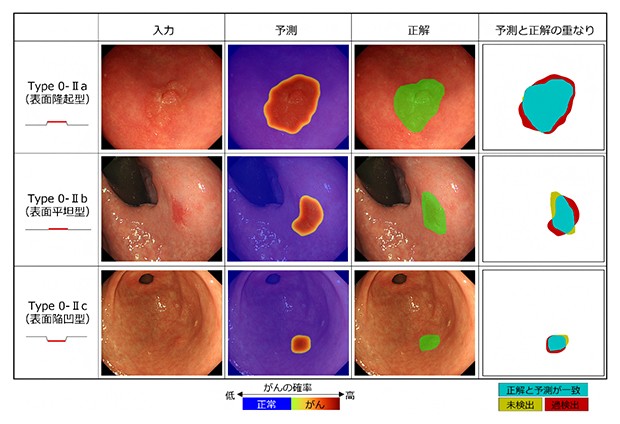

図2 内視鏡検査画像に対する専門医の範囲診断とAIによる領域予測の比較 AIによる領域予測結果と専門医が作成した正解領域との重なりを示す。ここでは、早期胃がんの肉眼型分類のうち、表面隆起型(Type 0-Ⅱa)、表面平坦型(Type 0-Ⅱb)、表面陥凹型(Type 0-Ⅱc)の3タイプについて、代表的な結果例を示した。

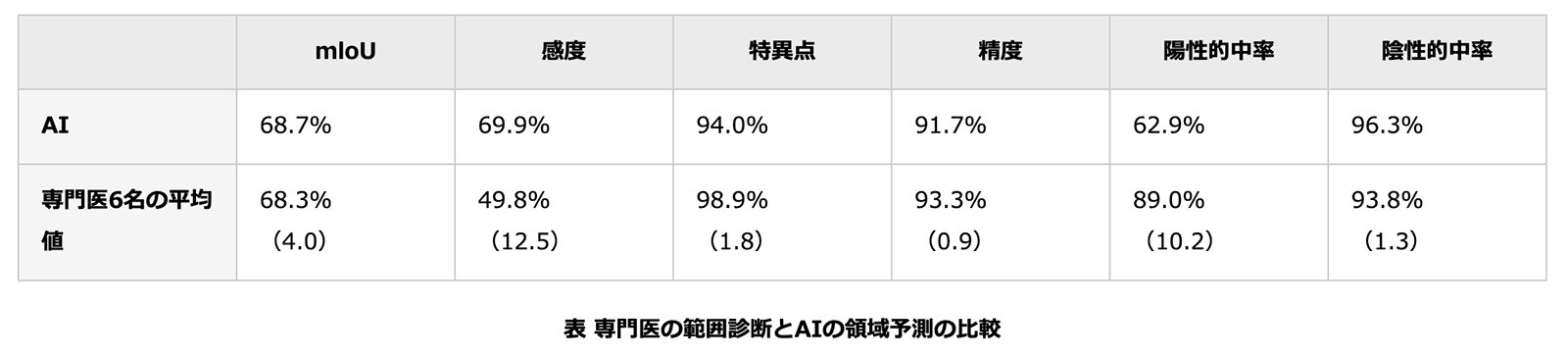

また予備調査として、AIが画像中で胃がんの存在を正しく判定したがん画像387枚のうち、無作為に抽出した38枚に対し、6名の消化器内視鏡専門医とAIによる病変の検出能、および範囲診断を比較した。なお、日常診療では医師は拡大内視鏡やNBI内視鏡を併用することが多いが、今回の比較では専門医は通常白色光を用いた非拡大内視鏡からの画像のみを用いた。その結果、AIは感度に優れ、mIoUは専門医とほぼ同等の精度を獲得した(表)。研究グループでは、早期胃がん領域の予測に関して、AIが専門医の範囲診断に迫る性能を獲得したのは本研究が初めてだとしている。

AIは専門医に比べて感度に優れ、mloUはほぼ同等であった。感度とは陽性のものを正しく陽性と判断する割合、特異度とは陰性のものを正しく陰性と判断する割合のことである。なお括弧内は標準偏差を示す。

研究グループでは今回の成果について、開発したAIが早期胃がんの領域予測に関して内視鏡専門医による範囲診断と同等の性能を示すことが出来、将来、増加が予想される検診や日常診療への内視鏡画像診断の導入に際して、医師の負担および診断能の差を軽減するなど、診断技術の均てん化に資する強力なツールとなるものと期待できるとしている。また少量の学習用データで効率的にAIを開発できたことは、他施設や他装置の画像に適用するための再学習が容易であるというメリットがあり、例えば希少がんなどのように、学習用データの収集が困難である対象にも適用できる可能性があるとしている。

※1 データ拡張

学習用データに変換を加えて、データ量を増やすこと。特に大量の学習データが必要なCNNなどで学習の性能向上に役立つ。変換には、拡大縮小、反転、回転シフト、色変換などがある。

※2 畳み込みニューラルネットワーク(CNN)

画像の分類や識別で高い性能を発揮するディープラーニングの一つ。あらかじめ与えられていた画像データから画像の特徴量を直接抽出し、ネットワークを学習する。CNNはConvolutional neural networkの略。

※3 重み付け関数

ここでは、ブロックごとに予測された病変の存在確率を元の画像に重ね合わせる際、予測値に掛け合わせる重みを画素ごとに決める関数のこと。ブロックの中央に近い画素には大きな重みを、遠い画素には小さい重みとなるようあらかじめ定義し、ブロックごとの存在確率と各画素の重みを掛け合わせた値が各画素の予測値となる。各画素は複数のブロックにまたがるため、実際には複数回の予測値の平均値を最終的な予測値とした。

※4 陽性的中率、陰性的中率

陽性的中率とは、例えば検査で陽性(今回のケースでは、胃がん)となった場合に、真に陽性(がん)が存在する割合のこと。陰性的中率とは、検査で陰性(ここでは、胃がんではない)となった場合に、真に陰性(正常または胃がんではない)である割合のこと。

※5 IoU、mIoU

IoUは、正解領域(例えば、人がラベル付けした領域)と予測領域の重なり具合を示す指標の一つ。重なりが大きいほど大きな値となる。mIoU(mean IoU)はクラスごとに領域の重なり(IoU)を計算した平均値。ここでは「がん」と「正解」のそれぞれのクラスについて、正解領域との重なりを計算した平均値を示している。IoUはIntersection over Unionの略。